人工智能开发的原则与人工智能应用软件开发

随着人工智能(AI)技术的飞速发展,人工智能应用软件已经渗透到各行各业。成功的AI软件开发不仅依赖于前沿技术,还需要遵循一系列核心原则。这些原则确保AI系统可靠、公正且可持续,同时推动创新。

1. 伦理与透明度原则

人工智能开发必须以伦理为基础。开发者应确保AI系统决策过程透明,尤其是在医疗、金融和司法等高风险领域。例如,通过可解释AI(XAI)技术,用户可以理解模型如何得出结论,减少“黑箱”操作的风险。避免偏见是伦理原则的关键。训练数据需要多样化,以防止算法对特定群体产生歧视,从而促进公平性。

2. 安全与可靠性原则

AI应用软件必须保证安全性和可靠性。这包括数据安全,防止未经授权的访问和数据泄露,以及系统稳定性,确保在高压环境下正常运行。开发者应采用严格的测试和验证流程,例如通过模拟攻击来评估系统的韧性。在自动驾驶或医疗诊断等关键应用中,错误可能导致严重后果,因此冗余设计和故障恢复机制至关重要。

3. 用户中心设计原则

AI软件开发应以用户需求为核心。通过用户研究和迭代设计,开发者可以创建直观、易用的界面。例如,在智能助手应用中,自然语言处理(NLP)技术应适应不同用户的语言习惯,提高交互体验。收集用户反馈并持续优化模型,确保软件能够解决实际问题,而不是仅仅追求技术复杂性。

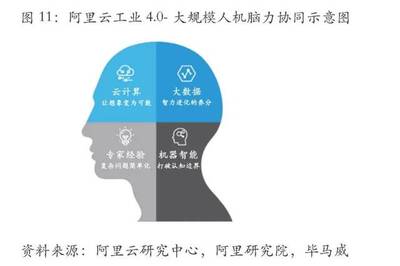

4. 可持续性与可扩展性原则

随着数据量和用户需求的增长,AI系统必须具备可扩展性。采用模块化架构和云计算资源,可以轻松扩展处理能力。可持续性涉及能源效率,例如优化算法以减少计算资源消耗,从而降低环境影响。在长期开发中,维护和更新机制也应纳入设计,以应对技术演进和法规变化。

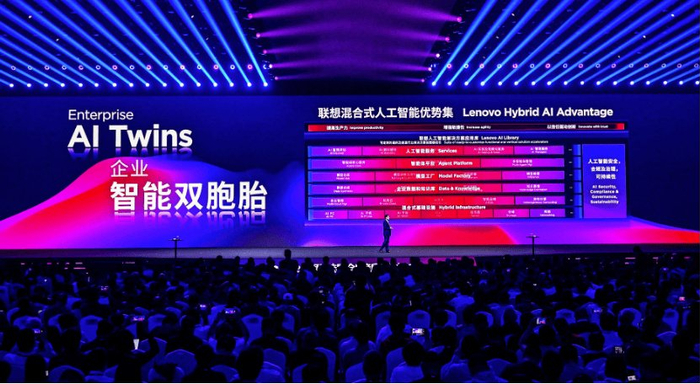

5. 创新与协作原则

人工智能领域日新月异,开发者应拥抱创新,同时鼓励跨学科协作。通过开源社区和行业合作,可以共享知识,加速突破。例如,在开发AI驱动的教育软件时,结合教育学专家的见解,能更好地个性化学习路径。创新不限于技术,还包括商业模式,如将AI与物联网(IoT)结合,创造新的应用场景。

人工智能应用软件开发是一个多维度过程,需要平衡技术、伦理和用户体验。通过遵循这些原则,开发者可以构建出高效、可信赖的AI系统,为社会带来持久价值。随着AI技术的成熟,这些原则将继续演化,推动行业迈向更高标准。

如若转载,请注明出处:http://www.kouyijiang.com/product/16.html

更新时间:2026-06-03 04:49:08